Прокачали тарифы: теперь безлимит в Start и Max для ваших самых смелых идей

Llama 3.1 и 3.2 – “самые способные” опенсорсные модели

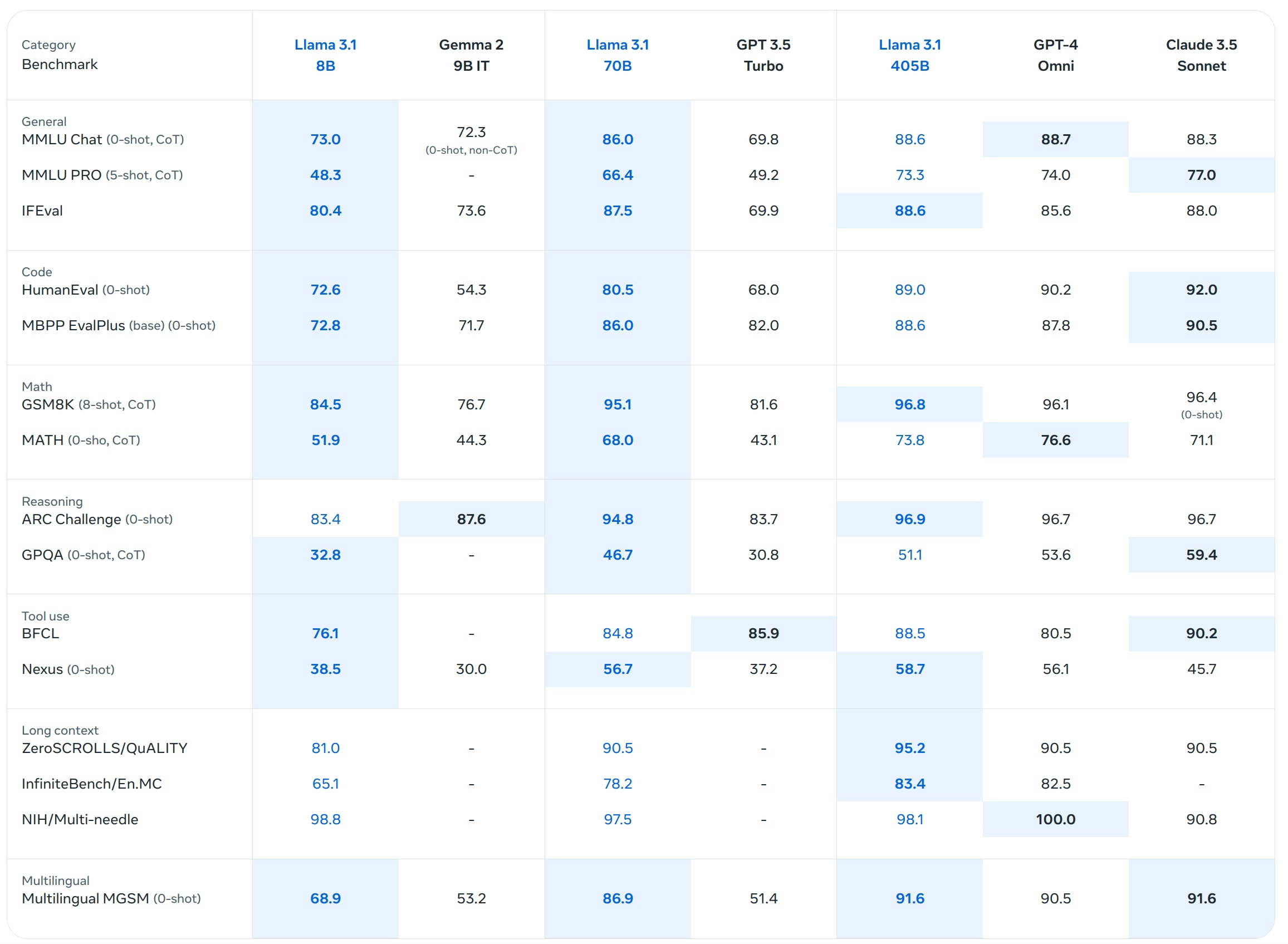

Llama – это флагманская нейросеть компании Meta1. По бенчмаркам языковая модель превосходит большинство платных аналогов, а объем знаний у нее больше, чем у Gemini Pro 1.5 и Claude 3 Sonnet. ИИ Llama распознает 30 языков, а умный ассистент на базе Llama 3 встроен во все мессенджеры и социальные сети, принадлежащие корпорации: Instagram2, WhatsApp и т.д.

Особенностью нейросети является доступ к актуальной информации через поисковые системы. Чат-бот Llama обрабатывает запросы пользователя, используя свежие данные из Google и Bing. Причем поиск запускается не только в браузере, но и в приложениях. Это выглядит как стандартный ответ нейросети плюс ссылка на найденную информацию в поисковике.

Кроме работы с текстом, модели Llama 3.1 умеют генерировать изображения по запросу, а мультимодальные новинки, относящиеся к Llama 3.2 – обрабатывают фото, видео- и аудиоконтент.

Почему именно Llama считают главным конкурентом Open AI? Как она может кардинально изменить наше взаимодействие с ИИ? И почему нейросеть с открытым исходным кодом – это хорошо, – отвечаем в нашей статье.

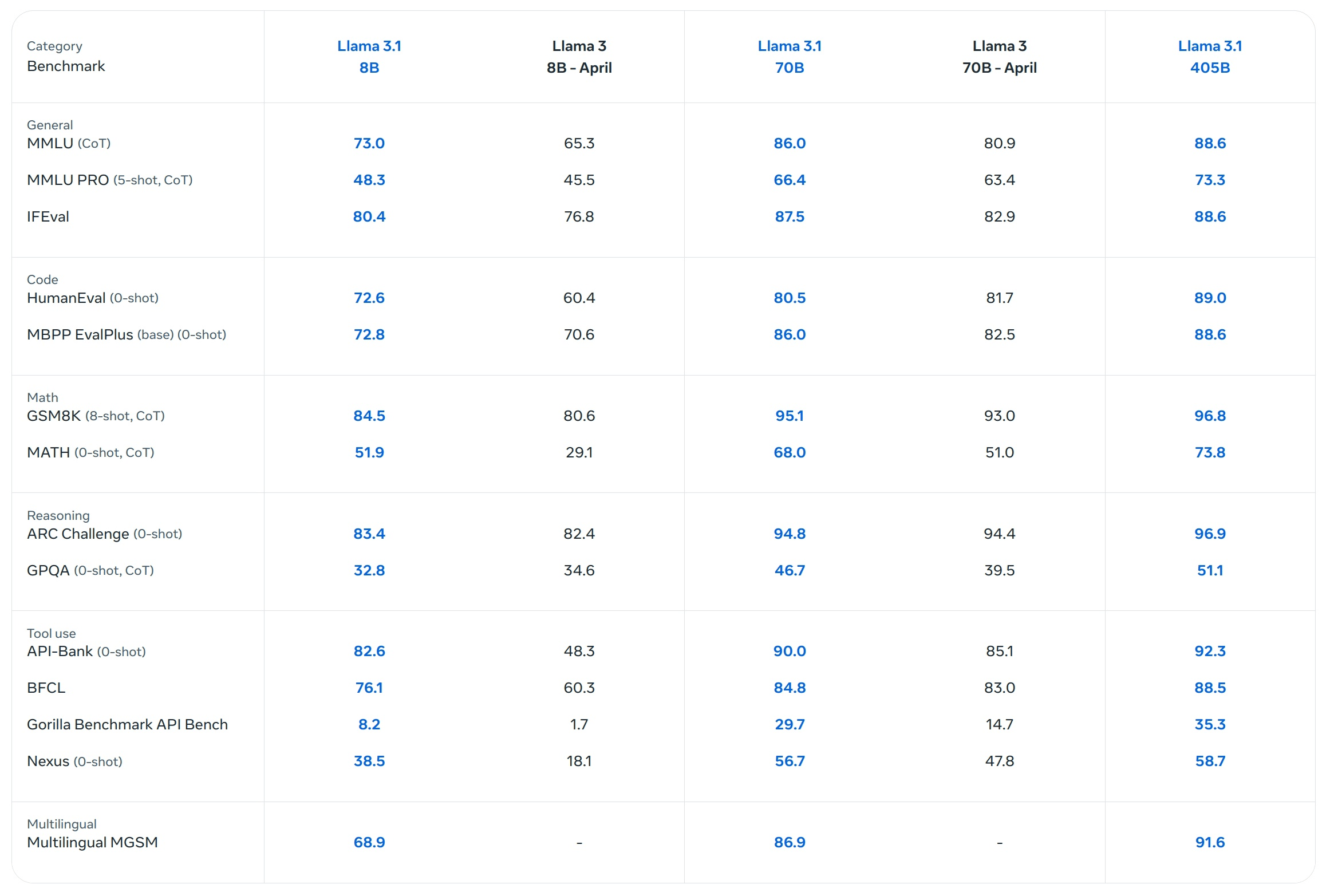

Модели Llama 3.1

| Дата релиза | 23 июля 2024 года |

| Понимание языка | 88,6% |

| Генерация кода | 89,0% |

| Решение проблем научного характера | 96,9% |

| Решение математических задач | 73,8% |

| Оценки возможностей рассуждения | 79,1% |

| Рассуждения на уровне выпускника | 51,1% |

| Вызов функций в реальном мире | 88,5 |

Преимущество семейства моделей Llama – в открытом исходном коде. Разработчики и другие пользователи могут свободно применять и модифицировать нейросеть в своих целях.

В линейку Llama 3.1 входят версии разной мощности: 8B, 70B и 405B.

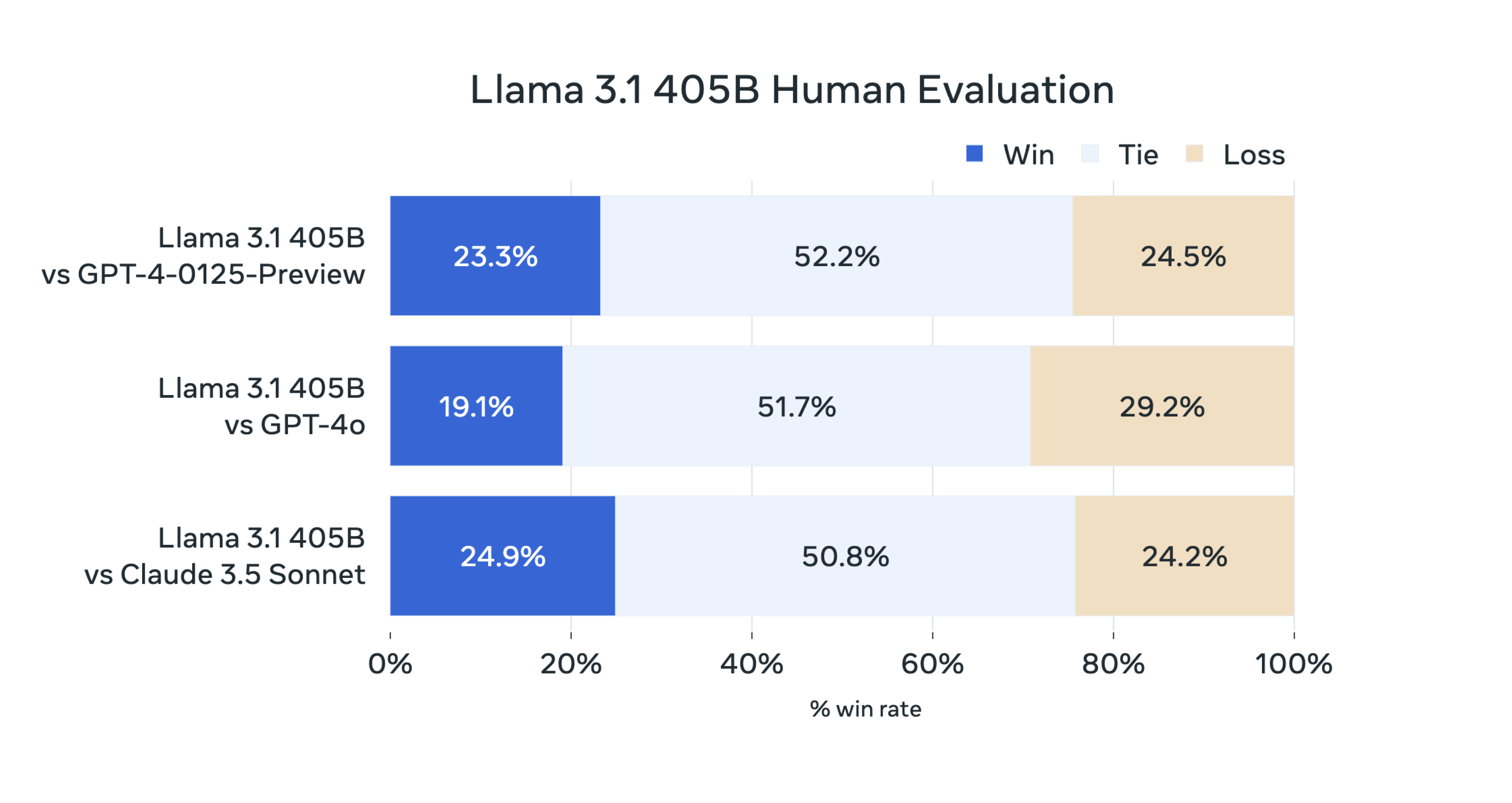

Флагманская Llama 3.1 от Meta1 405B – самая продвинутая модель в семействе. Она обучена на 15 триллионах токенов и свободно конкурирует с GPT и Claude. Версия демонстрирует высокие результаты в задачах, требующих общих знаний, математических вычислений и перевода с разных языков.

Все модели семейства Llama 3.1 обладают расширенным контекстным окном в 128 тысяч токенов. Предыдущая версия принимала контекст до 8 тысяч токенов, чего категорически не хватало для задач, требующих анализа и обработки документов, текстов, датасетов.

Нейросеть Llama тонко настраивается и адаптируется под конкретные задачи проекта. Разработчики могут дообучать модель на собственных датасетах. Например, чтобы создать уникальное решение для медицинской диагностики или анализа финансовых документов. А функция вызова внешних инструментов расширяет возможности ИИ за пределы простой обработки текста.

Модели Llama 3.1 используются для создания чат-ботов, написания кода, генерации данных для обучения других нейросетей и многого другого. На базе Llama уже создан AI-помощник для обучения, интегрированный в WhatsApp.

Несмотря на открытый исходный код, разработчики уделяют внимание этичному использованию ИИ. Корпорация Meta выпустила Llama Guard 3 для многоязычной безопасности и Prompt Guard для защиты от инъекций промптов.

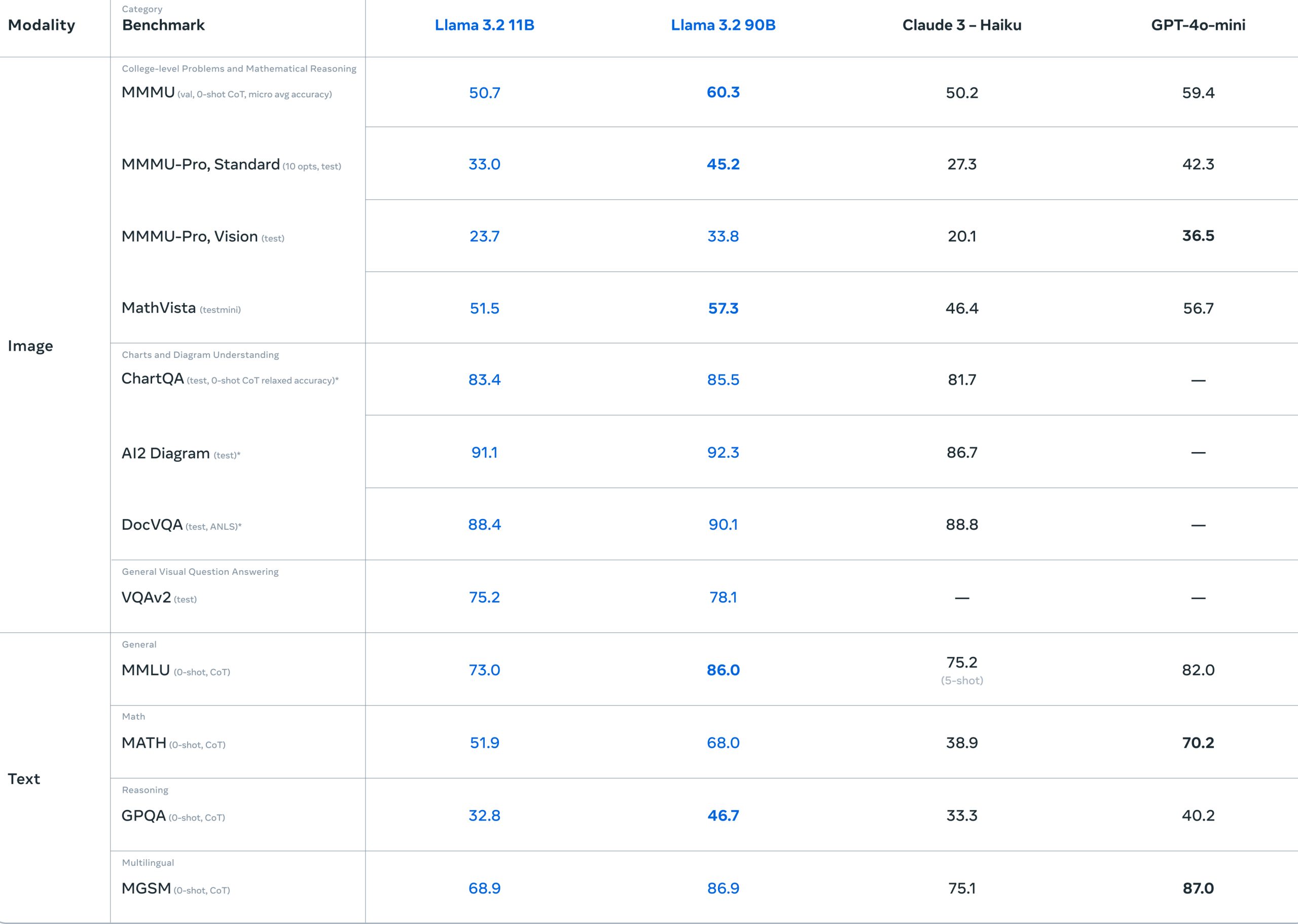

Модели Llama 3.2

| Дата релиза | 25 сентября 2024 года |

| Понимание языка | 63,4% |

| Экстремальное обобщение | 19,0% |

| Следовать инструкциям | 48,0% |

| Оценки возможностей рассуждения | 78,6% |

| Рассуждения на уровне выпускника | 32,8% |

| Вызов функций в реальном мире | 67,0% |

| Знания на уровне бакалавра | 60,3% |

| Анализ научных диаграмм | 85,5% |

Это последнее поколение нейросети на октябрь 2024 года. Есть несколько версий, которые отличаются мощностью: 1B, 3B и мультимодальные 11B, 90B. Более мощные – умеют обрабатывать текст, аудио и видео. Llama 3.2 работает на мобильных устройствах, планшетах и даже умных очках.

Модель можно установить локально и использовать без подключения к Интернету, что позволяет работать с документами в автономном режиме. Нейросеть анализирует и обрабатывает запросы прямо на устройстве, не отправляя их в облако. Это пригодится специалистам, чья деятельность связана с конфиденциальной информацией.

Llama 3.2 оптимизирована для запуска на устройствах с ограниченными ресурсами. Благодаря улучшенным алгоритмам сжатия и оптимизации вычислений, нейросеть работает и на серверных видеокартах, и на обычных смартфонах.

Новая версия получила поддержку мультимодальных данных. Llama 3.2 11B и 90B умеют работать с текстом, изображениями и звуком: например, могут просканировать фотографию, сгенерировать описание и синтезировать его в речь.

Создатели модели улучшили обработку и генерацию естественного языка. Теперь пользователи получают более уместные и логичные ответы. Еще нейросеть может управлять умным домом, анализировать данные с сенсоров, взаимодействовать с виртуальными объектами в AR и VR.

Llama 3 для локального использования

Работа с большинством больших языковых моделей – LLM – невозможна без доступа в интернет. Однако, если нужно дообучить нейронку под свой проект, это крайне неудобно. Поэтому интерес к Llama, которую можно использовать локально, без доступа к мировой «паутине», вполне объясним. Десктопная версия позволяет взаимодействовать с моделью, не завися от наличия и скорости интернета.

Установка нейросети на компьютер требует начальных знаний программирования и английского языка, так как на русском Llama не выпускается.

Для использования offline-версии модели потребуется приложение Python 3.9 и выше. Модуль Python позволяет установить необходимые библиотеки PyTorch, Transformers и запустить скрипт для сборки образа Llama. Разработчики рекомендуют использовать виртуальные окружения для изоляции зависимостей проекта, чтобы избежать конфликты между библиотеками.

Скачать образ Llama можно из репозитория Github. Файлы мультимодальной нейросети c официального сайта весят до 160 ГБ.

Перед загрузкой необходимо убедиться, что технические характеристики устройства соответствуют системным требованиям для установки Llama:

- операционная система Windows, Linux или macOS;

- 64-разрядный процессор;

- минимум 16 ГБ оперативной памяти;

- видеокарта NVIDIA с технологией CUDA (необязательно).

После скачивания всех компонентов можно запускать Llama, используя Python-скрипт.

Упрощают процесс установки и использования Llama фреймворки. Например, библиотека vLLM оптимизирует работу с языковыми моделями, эффективно распределяя ресурсы компьютера и ускоряя вывод.

Для работы с версиями на Llama 11B и 90B потребуется более мощное оборудование, в особенности более продвинутый GPU для обработки данных.

Как получить и использовать Llama API Key

Llama API – это интерфейс программирования приложений, который позволяет разработчикам взаимодействовать с языковой моделью. С помощью API можно интегрировать нейросеть в собственные приложения и сервисы.

Чтобы работать с Llama через API, требуется регистрация на официальном сайте и получение персонального ключа. Аккаунт можно создать бесплатно.

Работа с API происходит путем отправки запросов к серверу Llama. Разработчик формулирует задачу в виде текстового запроса, отправляет его и получает ответ от модели. Это дает возможность создавать приложения, используя готовую языковую модель и экономя ресурсы на создание собственной ИИ-модели с нуля.

API Key Llama позволяет отправлять запросы к нейросети прямо из IDE. Для удобства разработки и тестирования применяются инструменты Postman или curl. Многие языки программирования имеют встроенные библиотеки для работы с HTTP-запросами, что упрощает интеграцию API в существующие проекты.

Интеграция c Llama через API предоставляет несколько ключевых эндпоинтов, каждый из которых отвечает за определенный тип задач. Один эндпоинт можно применять для генерации текста на основе промпта, другой – для анализа контекста, третий – для ведения диалога в режиме реального времени.

Как пользоваться Llama в России

Доступ к Llama в нашей стране затруднен из-за блокировки компании Meta1 и ее продуктов. Воспользоваться нейросетью можно только через подменный IP. Чтобы установить Llama локально на компьютер, требуются минимальные знания языка программирования Python, что осложняет процесс для обычных пользователей.

При этом Llama помогает в решении широкого спектра задач и пригодится:

- В учебной деятельности. Поможет в исследованиях, написании эссе, подготовке к экзаменам, переводах с одного языка на другой.

- В бизнесе. Сгенерирует тексты для социальных сетей, блогов, карточек товаров на маркетплейсах.

- В творческой сфере. Упростит создание рассказов, сценариев, характеров персонажей и т.д.

Воспользоваться функционалом Llama без скачивания и установки дополнительных программ пользователи из России и стран СНГ могут через агрегатор нейросетей Mitup AI. Платформа позволяет работать с ИИ без VPN, скачивания дополнительных библиотек и знания языков программирования.

Для регистрации на сервисе достаточно ввести и подтвердить адрес электронной почты. Неавторизованным пользователям доступны 3 бесплатные генерации в день.

Сразу после регистрации юзеру начисляется бонус в размере 30 рублей. Общение с нейросетью происходит в привычном окне чат-бота. Кроме Llama, в агрегаторе доступны модели Gemini и GPT-4, которые также можно использовать для генераций.

1 Организация признана экстремистской и запрещена на территории РФ.

2 Сервис принадлежит Meta, признанной экстремистской и запрещенной на территории РФ.